AI 산업의 중심에 있는 NVIDIA가 차세대 AI 가속기 Vera Rubin AI accelerator를 올해 하반기 출시할 예정인데, 이 칩의 핵심 메모리인 HBM4 공급사로 한국 기업 두 곳만 선정된 것으로 알려졌다.

주인공은 바로

Samsung Electronics와 SK Hynix이다.

반면 글로벌 메모리 3위 기업인 Micron Technology은 이번 공급망에서 제외됐다. AI 메모리 경쟁에서 한국 기업의 기술력이 다시 한번 확인됐다는 평가가 나온다.

AI 성능을 좌우하는 ‘HBM4’

HBM은 High Bandwidth Memory(고대역폭 메모리)로, AI 서버와 GPU에서 사용되는 고성능 메모리다.

일반 D램과 달리 여러 개의 메모리를 수직으로 쌓아 올리는 구조를 갖고 있어 데이터 처리 속도가 매우 빠르다.

HBM4의 특징은 다음과 같다.

첨단 D램 8~16개 적층

GPU와 초고속 연결

AI 학습 및 추론 속도 향상

특히 베라루빈에 들어가는 HBM4는 동작 속도 10~11Gb, 총 메모리 용량 576GB 수준으로 알려졌다.

이는 경쟁사인 Advanced Micro Devices의 차세대 AI 가속기보다도 큰 용량이다.

왜 마이크론은 탈락했을까

HBM4 공급망에서 마이크론이 빠진 이유는 크게 두 가지로 분석된다.

1. 높은 성능 요구

엔비디아는 HBM4에 대해 국제 표준 8Gb보다 높은 10Gb 이상이라는 높은 성능 기준을 제시했다.

이 기준을 충족한 기업이 삼성과 SK하이닉스라는 것이다.

2. 수율과 양산 능력

HBM은 일반 D램보다 훨씬 제조 난도가 높다. 이 때문에 양품 비율(수율) 확보가 매우 중요하다.

엔비디아 입장에서는 안정적으로 대량 공급할 수 있는 기업을 선택할 수밖에 없다.

삼성전자 반도체, 분위기 반전

최근 몇 년간 삼성전자 반도체 사업은 HBM 공급 지연 문제로 어려움을 겪었다.

하지만 상황이 빠르게 바뀌고 있다.

삼성전자는 HBM3E 품질 테스트 통과, HBM4 테스트 사실상 통과, 일부 물량 출하등으로 다시 경쟁력을 입증하고 있다.

업계에서는 베라루빈용 HBM4에서는 삼성전자가 최대 공급사가 될 가능성도 제기된다.

SK하이닉스도 여전히 강력한 경쟁자

HBM 시장 1위인 SK하이닉스 역시 HBM4 개발을 빠르게 진행 중이다.

HBM 시장에서는 여전히 SK하이닉스가 강력한 위치를 유지하고 있다.

베라루빈 공개 일정

차세대 AI 가속기 베라루빈은 2026년 3월

NVIDIA GTC 2026에서 처음 공개될 예정이다.

정식 출시는 2026년 하반기가 유력하다.

엔비디아는 이 칩을 통해 AI 성능을 기존 대비 최대 5배 이상 끌어올리는 것을 목표로 하고 있다.

변수는 D램 가격 상승

한편 최근 범용 D램 가격이 빠르게 상승하고 있다는 점은 변수로 꼽힌다.

서버용 D램 가격이 상승하면서 일부 제품은 HBM3E와 비슷한 수준까지 올라왔다.

이 경우 메모리 기업 입장에서는 HBM 생산 확대, 일반 D램 생산 확대 사이에서 수익성 전략을 고민해야 할 상황이 될 수도 있다.

투자 관점에서 핵심 포인트

이번 뉴스에서 주목해야 할 점은 세 가지다.

1️⃣ 엔비디아 공급망 진입

삼성전자

SK하이닉스

AI 메모리 시장 주도권 유지

2️⃣ 마이크론 탈락

HBM 기술 경쟁에서 한국 기업 우위 확인

3️⃣ AI 메모리 수요 확대

HBM 시장은 앞으로도 지속적인 성장이 예상

AI 시대에서 엔비디아 공급망은 곧 반도체 기업의 경쟁력을 의미한다.

이번 베라루빈 프로젝트에서 삼성전자와 SK하이닉스가 핵심 공급사로 선정되면서, 향후 AI 메모리 시장의 주도권은 당분간 한국 기업들이 이어갈 가능성이 높다.

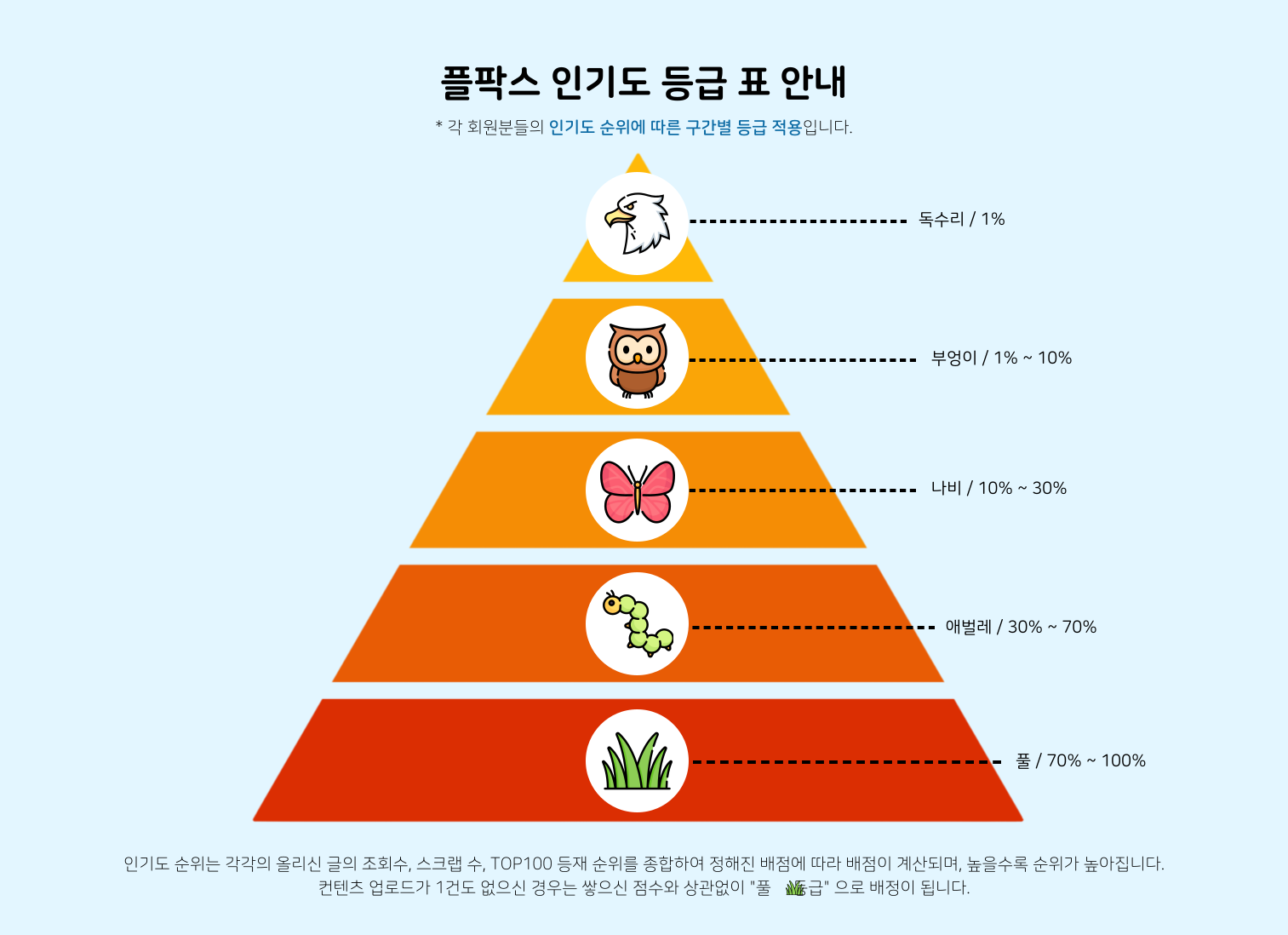

컨텐츠

컨텐츠