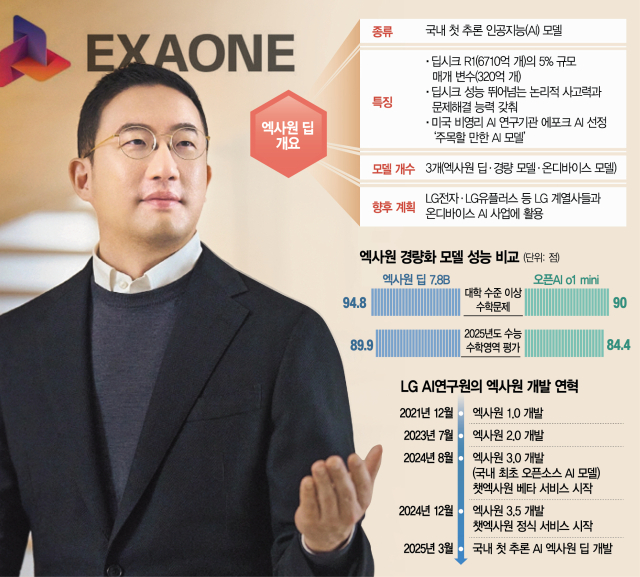

LG 인공지능(AI)연구원이 국내 최초로 자체 개발한 추론 AI ‘엑사원 딥’을 공개

LG AI연구원은 17∼21일(현지 시간) 미국 캘리포니아주 새너제이에서 열리는 엔비디아의 연례 개발자 콘퍼런스(GTC)에 참가해 엑사원 딥을 소개

기존 대규모언어모델(LLM)은 학습과 추론에 막대한 규모의 그래픽처리장치(GPU)와 전력이 필요해 천문학적인 비용이 뒤따랐음. 이에 구조를 최적화해 자원과 메모리 사용량을 줄인 경량화 대규모언어모델(sLLM)이 AI 업계에서 떠오르는데, LG가 이에 최적화된 대안을 제시한 것

추론 인공지능(AI) ‘엑사원 딥’의 강점은 모델 크기를 기존 빅테크보다 큰 폭으로 줄이면서 성능은 이들을 뛰어넘거나 비슷한 수준으로 유지한 것

LG AI연구원은 엑사원 딥의 지향점을 ‘에이전틱 AI’로 제시. 에이전틱 AI는 스스로 가설을 세우고 추론하는 과정에서 자율적인 의사결정을 할 수 있는 AI를 의미. 영화 아이언맨에 나오는 인공지능 비서 ‘자비스’가 궁극적인 에이전틱 AI의 모습

에이전틱 AI를 구현하려면 자체 추론 AI 개발이 필수

현재 미국 오픈AI와 구글, 중국 딥시크와 알리바바 등 소수 기업만 자체 추론 AI를 개발. LG AI연구원은 “엑사원 딥은 이들과 경쟁할 수 있는 국내 첫 모델”이라고 강조

LG AI연구원은 엑사원 딥을 공개하며 ‘오픈소스’ 방식을 택

딥시크보다 경량화하고 비슷한 성능

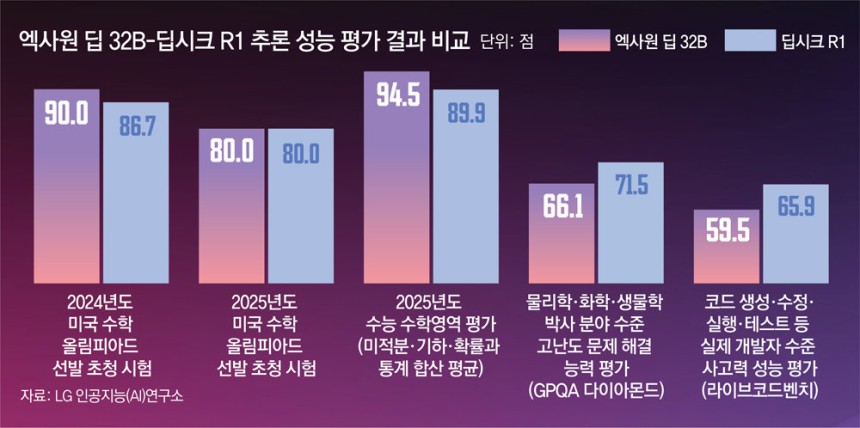

LG AI연구원이 공개한 ‘엑사원 딥 32B’는 매개변수가 320억 개로 딥시크 R1(매개변수 6710억 개)의 5% 정도. 하지만 AI가 발휘하는 성능은 비슷한 것으로 측정

엑사원 딥 32B는 수학, 과학 문제 해결 능력이 우수

엑사원 딥 32B는 수학 문제 해결 능력 평가 지표인 ‘MATH-500’에서 95.7점. 과학 문제 해결 능력을 평가하는 ‘GPQA 다이아몬드 테스트’에서도 66.1점을 받아 매개변수 규모가 유사한 추론 AI 모델들을 앞섰음

한국 기업이 개발한 AI인 만큼 한국어에 특화돼 있다는 것도 장점

LG AI연구원은 엑사원 딥 32B와 함께 개발한 경량 모델 ‘엑사원 딥 7.8B’, 온디바이스 모델 ‘엑사원 딥 2.4B’도 공개. 7.8B 모델은 매개변수를 32B 모델의 24% 정도로 줄였지만, 성능은 95%까지 유지하는 것으로 측정

구광모 회장의 AI 비전 결실 맺어

구 회장은 올해 신년사에서 “새로운 영역에 도전하고 전에 없던 가치를 만든 많은 순간들이 쌓여 지금의 LG가 됐다”며 “AI와 같은 첨단기술을 일상에서 편리하게 사용할 수 있게 해 소중한 시간을 보다 즐겁고 의미 있는 일에 쓰는 새로운 라이프 스타일을 만들어갈 것”이라고 강조

단순한 AI 모델을 넘어 궁극적으로는 스스로 가설을 세우고 추론하며 자율적인 의사 결정을 하는 ‘에이전틱 AI 모델’을 완성하겠다는 것

놀라운 부분은 LG의 AI 모델 개발 속도. 2021년 엑사원 1.0 개발 이후 2023년 엑사원 2.0 개발까지는 2년이 걸렸지만 이번 엑사원 딥과 전 모델(엑사원 3.5·지난해 12월 공개) 사이는 3개월에 불과. AI연구원 설립 4주년 만에 학습과 추론 등 전 분야 AI를 아울러 성과를 내고 있는 것

상반기 온디바이스 AI 모델을 LG유플러스의 자체 개발 AI 모델인 익시젠에 탑재하는 등 계열사와의 협업을 추진

<시사점>

LG가 국내 최초로 중국 딥시크 수준의 추론 인공지능 '엑사원 딥' 개발에 성공했습니다. 미래 시대는 AI시대임을 부정할 사람은 아무도 없을 것입니다. 미국과 중국에 이어 한국에서 제대로된 추론 AI의 등장은 IT강국인 우리나라의 체면을 살리고 새로운 도약을 꿈꿀 수 있게 합니다.

LG관계자에 따르면 모델 크기를 줄이면서도 성능을 유지한 면에서는 엑사원이 글로벌 AI업계 최고 수준이라고 자부하며, 다양한 산업에 적용될 수 있다고 자랑했습니다. 중국의 딥시크가 AI업계에 던진 충격은 고사양 고비용 HBM이 아닌 일반 반도체를 사용하면서도 효율적인 성능을 제공했다는 점입니다.

이번 LG의 엑사원은 매개변수가 딥시크의 5% 수준에 불과하지만 딥시크와 비슷한 성능을 냈다는 점에서 진일보한 측면이 있습니다. 매개변수가 적으면서 비슷한 성능이라는 것은 매개변수가 적어도 AI모델이 학습과 예측을 더 효율적으로 수행할 수 있다는 것을 의미하며, 딥시크보다 비용효율성이 뛰어나다는 사실입니다.

LG 엑시원이 딥시크보다 늦었지만 딥시크보다 더욱 비용 요율적인 모델을 만들었다는 점에서 한국의 AI개발 미래가 밝다고 하겠습니다.

<관련 기사>

https://n.news.naver.com/article/newspaper/020/0003622159?date=20250319

컨텐츠

컨텐츠